Historia de la serie de Taylor

Método de la Serie de Taylor El método de la serie de Taylor fue introducido por el matemático inglés Brook Taylor en su obra Methodus Incrementorum Directa et Inversa publicada en 1715. En esta obra, Taylor desarrolló una nueva rama de las matemáticas conocida como cálculo de las diferencias finitas, donde estudió los cambios de variable y presentó el desarrollo en serie de una función de una variable. Este método permitió determinar ecuaciones diferenciales que explican fenómenos físicos, como el movimiento de una cuerda vibrante y la trayectoria de un rayo de luz al atravesar un medio heterogéneo como la atmósfera .RTVE

La importancia del teorema de Taylor radica en su capacidad para reducir cálculos complejos de funciones a operaciones aritméticas elementales, como sumas y multiplicaciones. Aunque fue desarrollado en el siglo XVIII, su relevancia se mantuvo y fue destacada posteriormente por matemáticos como Joseph-Louis Lagrange, quien reconoció su utilidad en el desarrollo del cálculo diferencial. La serie de Taylor se ha convertido en una herramienta fundamental en análisis numérico y en diversas aplicaciones científicas e ingenieriles .RTVE

Funciones de la serie de Taylor

El teorema de Taylor y su fórmula, la serie de Taylor, es de gran valor en el estudio de los métodos numéricos. En esencia, la serie de Taylor proporciona un medio para predecir el valor de una función en un punto en términos del valor de la función y sus derivadas en otro punto. En particular, el teorema establece que cualquier función suave puede aproximarse por un polinomio.

Una buena manera de comprender la serie de Taylor consiste en construirla término por término. Por ejemplo, el primer término de la serie es:

Esta relación, llamada la aproximación de orden cero, indica que el valor de f en el nuevo punto es el mismo que su valor en el punto anterior. Tal resultado tiene un sentido intuitivo, ya que si y están muy próximas entre sí, entonces es muy probable que el nuevo valor sea similar al anterior. La ecuación ofrece una estimación perfecta si la función que se va a aproximar es, de hecho, una constante. Sin embargo, si la función cambia en el intervalo, entonces se requieren los términos adicionales de la serie de Taylor, para obtener una mejor aproximación. Por ejemplo, la aproximación de primer orden se obtiene sumando otro término para obtener:

Cómo se hace la Serie de Taylor

Teorema de Taylor

Sea una función real cuyas derivadas hasta orden existen y son continuas en un intervalo que contiene a los puntos y . Entonces, puede expresarse como:

Esta expresión se denomina expansión de Taylor de orden de la función centrada en . El término representa el residuo o error de truncamiento, es decir, la diferencia entre el valor exacto de la función y su aproximación polinómica.

Formas del residuo

- Forma integral (residuo de Cauchy):

Esta forma expresa el error como una integral que depende de la derivada de orden de .

- Forma de Lagrange (usando el teorema del valor medio para integrales):

donde es un punto intermedio entre y . Esta expresión proporciona una estimación más directa del error, basada en el comportamiento de la derivada de orden .

Importancia del Teorema

El Teorema de Taylor permite aproximar funciones suaves (es decir, derivables y continuas) mediante polinomios. Esta técnica es fundamental en:

- Análisis numérico (para estimar errores).

- Métodos de solución de ecuaciones diferenciales.

- Simulación computacional.

- Desarrollo de algoritmos en cálculo científico.

En contextos computacionales, es frecuente usar la forma:

donde:

- representa el incremento o tamaño de paso.

- es el error asociado a la aproximación de orden .

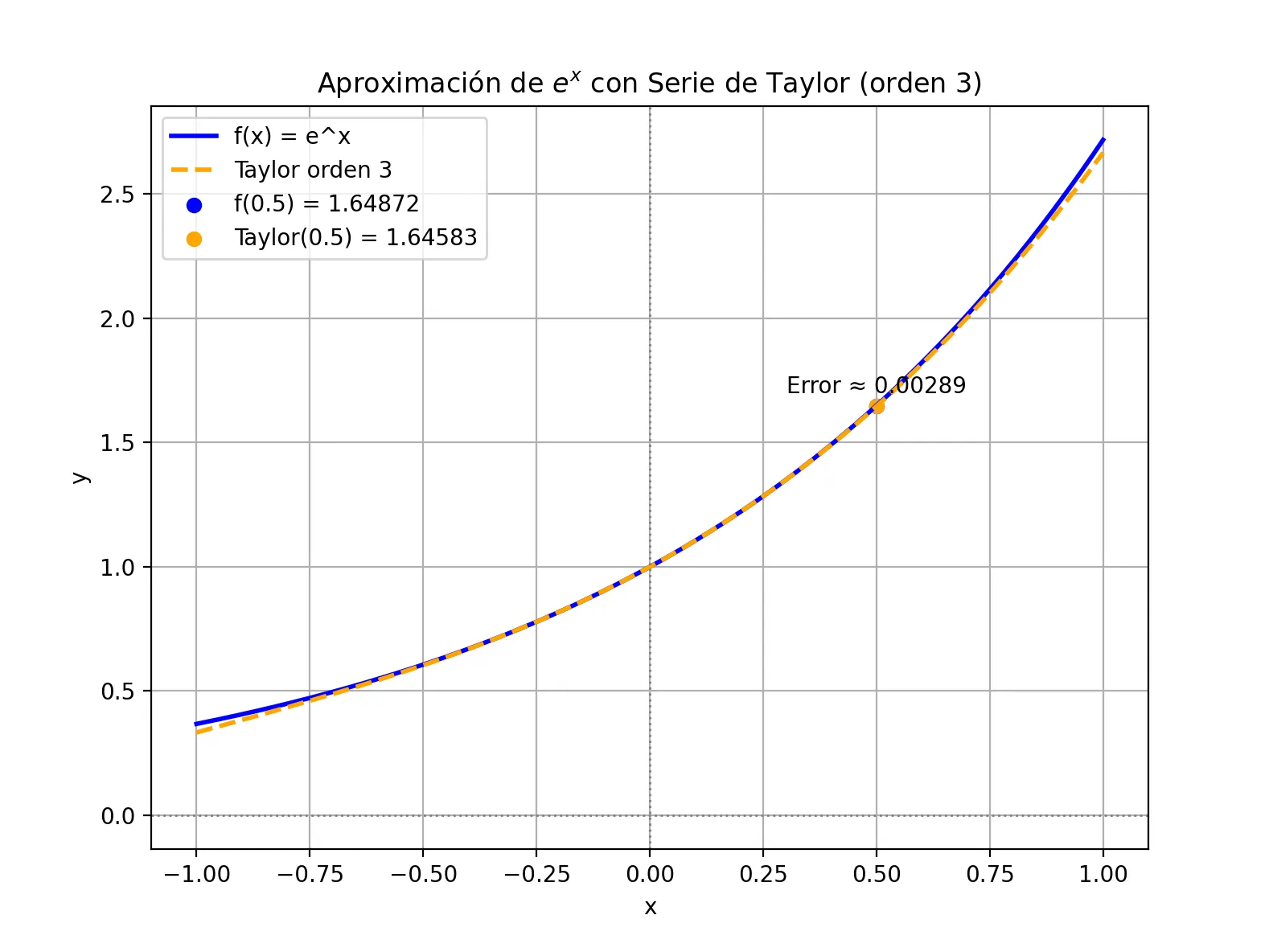

Ejemplo: Aproximar cerca de usando el polinomio de Taylor de orden 3

Queremos aproximar alrededor de , evaluando en un punto cercano, por ejemplo , usando un polinomio de tercer orden.

Sabemos que:

Entonces, evaluadas en :

Usamos la fórmula general:

Sustituimos :

Sabemos que:

Entonces el error de truncamiento es:

Usamos la forma de Lagrange del residuo para estimar el error máximo

Como , el valor máximo de en ese intervalo es . Entonces:

Esto confirma que el error real (0.00289) está dentro del límite estimado.

Implementación en código de la Serie de Taylor

import math

# Definimos la función original

def f(x):

return math.exp(x)

# Punto alrededor del cual se expande (a = 0)

a = 0

# Punto donde queremos evaluar (x = 0.5)

x = 0.5

# Cálculo del polinomio de Taylor de orden 3

def taylor_exp_order3(x, a):

term0 = f(a)

term1 = f(a) * (x - a)

term2 = f(a) * (x - a)**2 / math.factorial(2)

term3 = f(a) * (x - a)**3 / math.factorial(3)

return term0 + term1 + term2 + term3

# Evaluar la aproximación y el valor real

approx = taylor_exp_order3(x, a)

exact = f(x)

error = abs(exact - approx)

# Estimar el residuo con la forma de Lagrange

# Usamos el máximo valor posible de f^{(4)} en [0, 0.5] → e^0.5

residuo_max = math.exp(0.5) * (x - a)**4 / math.factorial(4)

# Mostrar resultados

print(f"Valor exacto de e^{x} : {exact}")

print(f"Aproximación con Taylor orden 3: {approx}")

print(f"Error real : {error}")

print(f"Error estimado (residuo) : {residuo_max}")

Salida

Valor exacto de e^0.5 : 1.6487212707001282

Aproximación con Taylor orden 3: 1.6458333333333333

Error real : 0.002887937366794871

Error estimado (residuo) : 0.004288337295208584Grafica

Explicación visual de la serie de Taylor

Conslusión

El método de la Serie de Taylor es fundamental en análisis numérico debido a su capacidad para aproximar funciones complejas con polinomios. Este método tiene un amplio rango de aplicaciones, especialmente en física e ingeniería, ya que permite modelar fenómenos continuos de forma eficiente y precisa. La expansión en series de Taylor ofrece una representación matemática que facilita el cálculo de soluciones en problemas donde los métodos exactos son impracticables.

El uso de este método sigue siendo relevante porque permite aproximar valores de funciones de manera directa y efectiva, sin necesidad de recurrir a algoritmos más complicados. Se usa comúnmente en la simulación de sistemas dinámicos y el análisis de errores en métodos numéricos, lo que lo convierte en una herramienta esencial para la resolución de ecuaciones diferenciales y otros problemas complejos (Kincaid & Cheney, 2002).

Kincaid, D., & Cheney, W. (2002). Numerical Analysis: Mathematics of Scientific Computing (3rd ed.). Brooks/Cole.