Historia

El método de los mínimos cuadrados fue formalizado por Adrien-Marie Legendre en 1805 y posteriormente desarrollado por Carl Friedrich Gauss en 1809. Este método se utiliza para encontrar la mejor aproximación lineal a un conjunto de datos, minimizando la suma de los cuadrados de las diferencias entre los valores observados y los valores predichos por el modelo. Wikipedia

La técnica de mínimos cuadrados ha sido fundamental en el desarrollo de la estadística y el análisis de datos, con aplicaciones que van desde la astronomía hasta la economía. Su capacidad para manejar datos ruidosos y proporcionar estimaciones óptimas la ha convertido en una herramienta esencial en la modelización y la inferencia estadística.

Funciones del Método de Aproximación por Mínimos Cuadrados

La Aproximación por Mínimos Cuadrados es una técnica numérica utilizada para encontrar la mejor aproximación lineal (o de otro tipo) a un conjunto de datos. El objetivo principal es minimizar la suma de los cuadrados de las diferencias entre los valores observados y los valores predichos por el modelo.

Función Objetivo:

La función objetivo del método de Mínimos Cuadrados se define como la suma de los cuadrados de los errores:

Donde:

- son los valores observados,

- son los valores de la variable independiente,

- y son los coeficientes del modelo lineal que queremos encontrar.

Cálculo de los Coeficientes:

Para minimizar , derivamos con respecto a y y resolvemos el sistema de ecuaciones:

Resolviendo este sistema se obtienen los coeficientes óptimos:

Ecuación de la Recta Ajustada:

Una vez calculados y , la ecuación de la recta ajustada es:

Error Cuadrático Medio (ECM)

El ECM mide qué tan buena es la aproximación. Se calcula como:

¡Vamos con los pasos bien explicados y claros para tu blog! 😊

Pasos para Resolver el Método de Aproximación por Mínimos Cuadrados

Recopilación de Datos

Se necesita un conjunto de puntos que representan las observaciones de la variable independiente y la variable dependiente .

Cálculo de las Sumatorias Necesarias

Para poder encontrar los coeficientes y , se calculan las siguientes sumatorias:

- → Suma de todos los valores de .

- → Suma de todos los valores de .

- → Suma de los cuadrados de cada valor de .

- → Suma del producto de cada par de valores .

Aplicación de las Fórmulas para los Coeficiente

Los coeficientes de la recta ajustada se encuentran con las siguientes fórmulas:

Donde:

- es el número de puntos.

Construcción de la Ecuación de la Recta Ajustada

Con los valores de y , se forma la ecuación lineal:

Cálculo del Error Cuadrático Medio (opcional)

Si se desea conocer la precisión del ajuste, se puede calcular el Error Cuadrático Medio (ECM):

Interpretación de Resultado

Finalmente, se interpreta la ecuación obtenida, donde:

- El valor de representa el punto donde la recta cruza el eje (intersección).

- El valor de indica la pendiente, es decir, el cambio en por cada unidad que cambia .

¡Vamos con el ejemplo bien estructurado para tu blog! 😊

Ejemplo Resuelto: Método de Aproximación por Mínimos Cuadrados

Supongamos que tenemos el siguiente conjunto de datos que representan el comportamiento de una variable dependiente en función de una variable independiente :

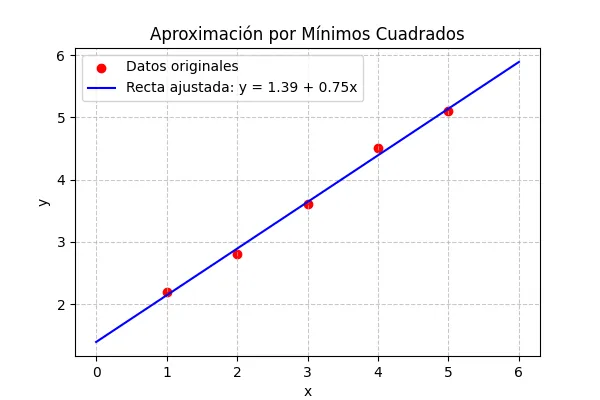

| 1 | 2.2 |

| 2 | 2.8 |

| 3 | 3.6 |

| 4 | 4.5 |

| 5 | 5.1 |

Queremos encontrar la recta que mejor se ajuste a estos datos utilizando el método de Mínimos Cuadrados.

Paso 1: Recopilación de datos

Los puntos a interpolar son:

Paso 2: Cálculo de las sumatorias necesarias

Paso 3: Aplicación de las fórmulas para los coeficientes

Ahora calculamos :

Paso 4: Ecuación de la recta ajustada

Finalmente, la ecuación de la recta que aproxima mejor los datos es:

Ejemplo en Python

# Reimportar librerías y reejecutar el código tras el reset

import matplotlib.pyplot as plt

import numpy as np

# Datos del ejemplo

x = np.array([1, 2, 3, 4, 5])

y = np.array([2.2, 2.8, 3.6, 4.5, 5.1])

# Número de puntos

n = len(x)

# Cálculo de las sumatorias

sum_x = np.sum(x)

sum_y = np.sum(y)

sum_x2 = np.sum(x**2)

sum_xy = np.sum(x * y)

# Cálculo de los coeficientes a y b

b = (n * sum_xy - sum_x * sum_y) / (n * sum_x2 - sum_x**2)

a = (sum_y - b * sum_x) / n

print(f"Coeficientes: a = {a:.2f}, b = {b:.2f}")

# Ecuación de la recta

x_line = np.linspace(0, 6, 100)

y_line = a + b * x_line

# Graficar

plt.figure(figsize=(6, 4))

plt.scatter(x, y, color='red', label='Datos originales')

plt.plot(x_line, y_line, color='blue', label=f'Recta ajustada: y = {a:.2f} + {b:.2f}x')

plt.title('Aproximación por Mínimos Cuadrados')

plt.xlabel('x')

plt.ylabel('y')

plt.grid(True, linestyle='--', alpha=0.7)

plt.legend()

plt.show()Salida

Coeficientes: a = 1.39, b = 0.75Grafica

Explicacion visual

Conclusión: Método de Aproximación por Mínimos Cuadrados

La aproximación por mínimos cuadrados es un método estadístico utilizado para minimizar la suma de los cuadrados de las diferencias entre los datos observados y los valores predichos por el modelo. Es fundamental en el análisis de regresión y en la aproximación de soluciones cuando los datos son ruidosos o no exactos. Este método se usa en una amplia variedad de campos, incluidos la economía, la ingeniería y las ciencias sociales.

La relevancia de este método es que permite encontrar una solución óptima para problemas de ajuste de curvas y regresión, incluso cuando los datos contienen errores o incertidumbres. Se utiliza de manera rutinaria en la modelización de fenómenos naturales y en la predicción de tendencias a partir de datos experimentales, lo que lo convierte en una herramienta esencial en el análisis de datos (Golub & Van Loan, 2013).

Golub, G. H., & Van Loan, C. F. (2013). Matrix Computations (4th ed.). Johns Hopkins University Press.